Forwarded from Малоизвестное интересное

Внушенные галлюцинации ИИ

Можно без натяжки сказать, что, по сравнению с человеком, ИИ обладает куда более развитыми истерическими свойствами.

Так здоровый, но внушаемый (с истерическими чертами характера) человек может вслед за больным "увидеть" черта, ангелов, летающие тарелки и, вообще, что угодно. Однако, подобные люди – редкость (их порядка процента).

В отличие же от людей, каждый ИИ – законченный истерик. Заставить его видеть вместо стула – черта, вместо шишек – ангелов, а вместо милиционера – летающую тарелку, - совсем не бином Ньютона.

Называется этот трюк - использование «враждебных данных» (adversarial inputs), заставляющих ИИ видеть какие-то обманные образы (а по сути, - вызывать у ИИ внушенные галлюцинации).

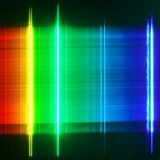

Вот перед вами 3 картинки

✔️ Левая –фото ленивца, распознаваемого ИИ с вероятностью > 99%.

✔️ Средняя – фото гоночного авто. Это галлюцинация, которую нужно внушить ИИ, показавая ему слегка модифицированное с помощью «враждебных данных» фото ленивца.

✔️ Правая – это результат: модифицированное с помощью «враждебных данных» фото ленивца, в котором ИИ с вероятностью > 99% распознает гоночное авто.

❗️ Объем «враждебных данных», потребовавшихся для внушения ИИ галлюцинации гоночного автомобиля, видимого им вместо ленивца, пренебрежительно мал – всего 0,0078 отличий в пикселях правого и левого фото (человеческий глаз этого просто не видит – хотя вы можете попробовать).

Представить потенциал ущерба от использования «враждебных данных» злоумышленниками можете сами. Лишь замечу, - теоретически, он сопоставим с ядерным оружием.

И если вы думаете, что внушением галлюцинаций для ИИ никто на практике не занимается, вы жутко ошибаетесь. Всего один, но замечательный пример.

В Китайских соцсетях и мессенджерах фильтруется весь контент, затирая в ноль всё запрещенное партией и правительством (в этот список входит несколько тысяч тем!).

— Сначала фильтровали только текст.

— Но пользователи приспособились и для обмана фильтров стали запрещенные слова прятать в картинки.

— Тогда государство посадило 10 тыс. цензоров для фильтрации картинок. Но они не справились – дюже много работы.

— И вот тогда мобилизовали ИИ на фильтрацию картинок.

Вот как это выглядит. Китайский пользователь WeChat послал картинку – обложку отчета про кампанию репрессий, получившую название "облава 709" (709 Crackdown). ИИ-цензор эту картинку удалил.

И тут внимание.

Ушлые ребята из THECITIZENLAB придумали использовать ИИ для подбора «враждебных данных», способных внушить галлюцинации «ИИ-цензорам», ведущим фильтрацию. В исходных картинках меняется совсем чуть-чуть (как в примере с ленивцем). Поэтому людям эти изменения нипочем – они их просто не замечают. Тогда как «истерический характер ИИ» заставляет его видеть вместо картинок из черного списка что-то совсем иное. И крантец фильтрации – свобода китайским пользователям!

Вот пример. Изображения С и D фильтруются ИИ-цензором, в изображения A и B – нет 😳

Так ИИ-броня ИИ-цензуры оказалась легко пробиваема ИИ-снарядами «враждебных данных».

Но это не конец. ИИ-броня совершенствуется (равно как и ИИ-снаряды).

Детали этой борьбы можете прочесть в отчете

А это подробно про то, как работают «враждебные данные»

#МашинноеОбучение #AdversarialInputs

Можно без натяжки сказать, что, по сравнению с человеком, ИИ обладает куда более развитыми истерическими свойствами.

Так здоровый, но внушаемый (с истерическими чертами характера) человек может вслед за больным "увидеть" черта, ангелов, летающие тарелки и, вообще, что угодно. Однако, подобные люди – редкость (их порядка процента).

В отличие же от людей, каждый ИИ – законченный истерик. Заставить его видеть вместо стула – черта, вместо шишек – ангелов, а вместо милиционера – летающую тарелку, - совсем не бином Ньютона.

Называется этот трюк - использование «враждебных данных» (adversarial inputs), заставляющих ИИ видеть какие-то обманные образы (а по сути, - вызывать у ИИ внушенные галлюцинации).

Вот перед вами 3 картинки

✔️ Левая –фото ленивца, распознаваемого ИИ с вероятностью > 99%.

✔️ Средняя – фото гоночного авто. Это галлюцинация, которую нужно внушить ИИ, показавая ему слегка модифицированное с помощью «враждебных данных» фото ленивца.

✔️ Правая – это результат: модифицированное с помощью «враждебных данных» фото ленивца, в котором ИИ с вероятностью > 99% распознает гоночное авто.

❗️ Объем «враждебных данных», потребовавшихся для внушения ИИ галлюцинации гоночного автомобиля, видимого им вместо ленивца, пренебрежительно мал – всего 0,0078 отличий в пикселях правого и левого фото (человеческий глаз этого просто не видит – хотя вы можете попробовать).

Представить потенциал ущерба от использования «враждебных данных» злоумышленниками можете сами. Лишь замечу, - теоретически, он сопоставим с ядерным оружием.

И если вы думаете, что внушением галлюцинаций для ИИ никто на практике не занимается, вы жутко ошибаетесь. Всего один, но замечательный пример.

В Китайских соцсетях и мессенджерах фильтруется весь контент, затирая в ноль всё запрещенное партией и правительством (в этот список входит несколько тысяч тем!).

— Сначала фильтровали только текст.

— Но пользователи приспособились и для обмана фильтров стали запрещенные слова прятать в картинки.

— Тогда государство посадило 10 тыс. цензоров для фильтрации картинок. Но они не справились – дюже много работы.

— И вот тогда мобилизовали ИИ на фильтрацию картинок.

Вот как это выглядит. Китайский пользователь WeChat послал картинку – обложку отчета про кампанию репрессий, получившую название "облава 709" (709 Crackdown). ИИ-цензор эту картинку удалил.

И тут внимание.

Ушлые ребята из THECITIZENLAB придумали использовать ИИ для подбора «враждебных данных», способных внушить галлюцинации «ИИ-цензорам», ведущим фильтрацию. В исходных картинках меняется совсем чуть-чуть (как в примере с ленивцем). Поэтому людям эти изменения нипочем – они их просто не замечают. Тогда как «истерический характер ИИ» заставляет его видеть вместо картинок из черного списка что-то совсем иное. И крантец фильтрации – свобода китайским пользователям!

Вот пример. Изображения С и D фильтруются ИИ-цензором, в изображения A и B – нет 😳

Так ИИ-броня ИИ-цензуры оказалась легко пробиваема ИИ-снарядами «враждебных данных».

Но это не конец. ИИ-броня совершенствуется (равно как и ИИ-снаряды).

Детали этой борьбы можете прочесть в отчете

А это подробно про то, как работают «враждебные данные»

#МашинноеОбучение #AdversarialInputs