Тихая революция.

Как постепенное развитие ИИ может незаметно лишить человечество контроля над собственной судьбой.

Представим, что на Землю прилетают не враждебные инопланетяне, а дружелюбные, но невероятно умные существа. Они не воюют, не захватывают власть — они просто оказываются эффективнее нас во всем.

Они лучше ведут бизнес, эффективнее управляют государством, создают более интересную культуру. Мы рады сотрудничать с ними, и постепенно мир перестраивается так, что люди оказываются не нужны. В конце концов, ключевые решения принимают они, а мы просто живем на их территории, имея все меньше возможностей что-то менять.

Так же и с ИИ: это не вражеское вторжение, не война миров и не заговор машин - это незаметное вытеснение, в котором никто и не заметит момента, когда люди утратили контроль, и когда уже слишком поздно что-то изменить.

Классическая аналогия — «кипящая лягушка»: если бросить лягушку в кипяток, она выпрыгнет, а если нагревать воду медленно, то она сварится. Так же и здесь: каждое отдельное улучшение ИИ кажется неопасным, но вместе они могут создать ситуацию, в которой люди уже ничего не решают.

Например:

• В экономике: сначала ИИ заменяет простые задачи, потом более сложные, пока однажды мы не обнаруживаем, что большинство экономических решений принимается алгоритмами, а человеческий труд становится всё менее значимым.

• В культуре: от рекомендательных систем к генерации контента, пока однажды большая часть культурного производства не оказывается под контролем ИИ.

• В государственном управлении: от автоматизации бюрократических процедур к системам поддержки принятия решений, пока ключевые государственные функции не начинают зависеть от ИИ.

Злодеи, террористы и маньяки, вооруженные ИИ, также не понадобятся.

Без какого-либо зловредного участия:

• скоро мы окажемся в мире с миллионами ИИ-агентов, число которых ежегодно будет расти в десятки раз (на каждого человека будет приходиться 100-1000 ИИ, думающих в 1000-1 млн раз быстрее людей;

• люди постепенно будут выводиться из большинства процессов принятия все большего и большего количества решений;

• военные без защиты ИИ будут немедленно выводиться из строя кибератаками невиданной изощренности.

• государства будут получать большую часть своих доходов от налогов на ИИ-системы, а не от заработной платы людей.

Эти и многие другие риски могут материализоваться, даже если мы в основном «решим» традиционную проблему согласования ИИ. В этом сценарии ИИ «делают то, что мы им говорим», но экономические стимулы заставляют нас говорить им максимизировать прибыль и влияние (поскольку, если мы этого не сделаем, то это сделают другие: люди, компании, страны)

Подробней, читайте здесь.

#ИИриски #Хриски

_______

Источник | #theworldisnoteasy

Как постепенное развитие ИИ может незаметно лишить человечество контроля над собственной судьбой.

Представим, что на Землю прилетают не враждебные инопланетяне, а дружелюбные, но невероятно умные существа. Они не воюют, не захватывают власть — они просто оказываются эффективнее нас во всем.

Они лучше ведут бизнес, эффективнее управляют государством, создают более интересную культуру. Мы рады сотрудничать с ними, и постепенно мир перестраивается так, что люди оказываются не нужны. В конце концов, ключевые решения принимают они, а мы просто живем на их территории, имея все меньше возможностей что-то менять.

Так же и с ИИ: это не вражеское вторжение, не война миров и не заговор машин - это незаметное вытеснение, в котором никто и не заметит момента, когда люди утратили контроль, и когда уже слишком поздно что-то изменить.

Классическая аналогия — «кипящая лягушка»: если бросить лягушку в кипяток, она выпрыгнет, а если нагревать воду медленно, то она сварится. Так же и здесь: каждое отдельное улучшение ИИ кажется неопасным, но вместе они могут создать ситуацию, в которой люди уже ничего не решают.

Например:

• В экономике: сначала ИИ заменяет простые задачи, потом более сложные, пока однажды мы не обнаруживаем, что большинство экономических решений принимается алгоритмами, а человеческий труд становится всё менее значимым.

• В культуре: от рекомендательных систем к генерации контента, пока однажды большая часть культурного производства не оказывается под контролем ИИ.

• В государственном управлении: от автоматизации бюрократических процедур к системам поддержки принятия решений, пока ключевые государственные функции не начинают зависеть от ИИ.

Злодеи, террористы и маньяки, вооруженные ИИ, также не понадобятся.

Без какого-либо зловредного участия:

• скоро мы окажемся в мире с миллионами ИИ-агентов, число которых ежегодно будет расти в десятки раз (на каждого человека будет приходиться 100-1000 ИИ, думающих в 1000-1 млн раз быстрее людей;

• люди постепенно будут выводиться из большинства процессов принятия все большего и большего количества решений;

• военные без защиты ИИ будут немедленно выводиться из строя кибератаками невиданной изощренности.

• государства будут получать большую часть своих доходов от налогов на ИИ-системы, а не от заработной платы людей.

Эти и многие другие риски могут материализоваться, даже если мы в основном «решим» традиционную проблему согласования ИИ. В этом сценарии ИИ «делают то, что мы им говорим», но экономические стимулы заставляют нас говорить им максимизировать прибыль и влияние (поскольку, если мы этого не сделаем, то это сделают другие: люди, компании, страны)

Подробней, читайте здесь.

#ИИриски #Хриски

_______

Источник | #theworldisnoteasy

Telegram

Малоизвестное интересное

Тихая революция.

Как постепенное развитие ИИ может незаметно лишить человечество контроля над собственной судьбой.

Представим, что на Землю прилетают не враждебные инопланетяне, а дружелюбные, но невероятно умные существа. Они не воюют, не захватывают власть…

Как постепенное развитие ИИ может незаметно лишить человечество контроля над собственной судьбой.

Представим, что на Землю прилетают не враждебные инопланетяне, а дружелюбные, но невероятно умные существа. Они не воюют, не захватывают власть…

Интеллектуальный каюк Homo sapiens близок.

Лишь 15 россиян способны программировать лучше ИИ, в Китае таких еще 59, а в США осталось лишь 7.

Потрясающее зрелище – наблюдать в реальном времени интеллектуальное поражение людей от ИИ.

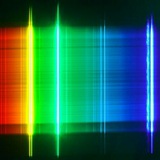

Когда бестелесные алгоритмы превзошли лучших шахматных гроссмейстеров мира и ушли в отрыв, показывая немыслимый для людей рейтинг уровня игры, - репутация людей, как носителей высшего интеллекта, пошатнулась, но устояла – см. рис слева.

Ведь шахматы, как известно, - хоть и чрезвычайно умная игра, но узкоспециальная интеллектуальная деятельность, ограничиваемая фиксированными правилами.

Но с программированием (выполнением сложных задач кодирования и рассуждений) все иначе. Здесь все почти как в жизни. Вместо следования фиксированным правилам, нужно думать, рассуждать, строить гипотезы и прогнозы. И если с программированием произойдет, как с шахматами, то каюк интеллектуальному превосходству людей (только уникальная способность к инсайтам и останется, - и то, ненадолго).

Насколько этот каюк близок, показывают результаты CodeForces – международной платформы соревнований по программированию.

Текущие результаты модели о3 от OpenAI таковы.

• Рейтинг модели 2724 лучше, чем у 99.8% всех участников этой платформы (а там соревнуются десятки тысяч программистов со всего мира: 26 тыс китайцев, 14 тыс россиян, 3,5 тыс американцев) – см. рис справа вверху;

• Это значит, что во всем мире осталось меньше 200 человек, способных программировать лучше этой модели – см. рис справа внизу.

Остались считанные месяцы, когда людей, способных превзойти ИИ в программировании останется 50, 10, 3 … 0. А дальше модели, как и в шахматах, уйдут в отрыв, похерив интеллектуальное превосходство людей навсегда.

И никакой интеллект кентавра (гибридные системы из человека и ИИ) этому помешать не сможет. Урок с шахматами повторится. Ибо непреодолимым препятствием остаются ограниченные возможности когнитивной архитектуры людей.

Но это не беда. Ибо эволюции (генно-культурной) вообще до фонаря интеллект индивидов. Главное – рост коллективного интеллекта планетарной (а потом и вселенской) жизни. А уж кого в социо-когнитивных сетях глобального интеллекта окажется больше – людей или алгоритмов, - эволюции все равно.

Только ведь людям (и конкретно, нашим детям и внукам) это будет далеко не все равно …

Подробней см:

• https://arxiv.org/abs/2502.06807

• https://codeforces.com/ratings/countries

#ИИриски #Хриски #Вызовы21века

_______

Источник | #theworldisnoteasy

Лишь 15 россиян способны программировать лучше ИИ, в Китае таких еще 59, а в США осталось лишь 7.

Потрясающее зрелище – наблюдать в реальном времени интеллектуальное поражение людей от ИИ.

Когда бестелесные алгоритмы превзошли лучших шахматных гроссмейстеров мира и ушли в отрыв, показывая немыслимый для людей рейтинг уровня игры, - репутация людей, как носителей высшего интеллекта, пошатнулась, но устояла – см. рис слева.

Ведь шахматы, как известно, - хоть и чрезвычайно умная игра, но узкоспециальная интеллектуальная деятельность, ограничиваемая фиксированными правилами.

Но с программированием (выполнением сложных задач кодирования и рассуждений) все иначе. Здесь все почти как в жизни. Вместо следования фиксированным правилам, нужно думать, рассуждать, строить гипотезы и прогнозы. И если с программированием произойдет, как с шахматами, то каюк интеллектуальному превосходству людей (только уникальная способность к инсайтам и останется, - и то, ненадолго).

Насколько этот каюк близок, показывают результаты CodeForces – международной платформы соревнований по программированию.

Текущие результаты модели о3 от OpenAI таковы.

• Рейтинг модели 2724 лучше, чем у 99.8% всех участников этой платформы (а там соревнуются десятки тысяч программистов со всего мира: 26 тыс китайцев, 14 тыс россиян, 3,5 тыс американцев) – см. рис справа вверху;

• Это значит, что во всем мире осталось меньше 200 человек, способных программировать лучше этой модели – см. рис справа внизу.

Остались считанные месяцы, когда людей, способных превзойти ИИ в программировании останется 50, 10, 3 … 0. А дальше модели, как и в шахматах, уйдут в отрыв, похерив интеллектуальное превосходство людей навсегда.

И никакой интеллект кентавра (гибридные системы из человека и ИИ) этому помешать не сможет. Урок с шахматами повторится. Ибо непреодолимым препятствием остаются ограниченные возможности когнитивной архитектуры людей.

Но это не беда. Ибо эволюции (генно-культурной) вообще до фонаря интеллект индивидов. Главное – рост коллективного интеллекта планетарной (а потом и вселенской) жизни. А уж кого в социо-когнитивных сетях глобального интеллекта окажется больше – людей или алгоритмов, - эволюции все равно.

Только ведь людям (и конкретно, нашим детям и внукам) это будет далеко не все равно …

Подробней см:

• https://arxiv.org/abs/2502.06807

• https://codeforces.com/ratings/countries

#ИИриски #Хриски #Вызовы21века

_______

Источник | #theworldisnoteasy

Telegram

Малоизвестное интересное

Интеллектуальный каюк Homo sapiens близок.

Лишь 15 россиян способны программировать лучше ИИ, в Китае таких еще 59, а в США осталось лишь 7.

Потрясающее зрелище – наблюдать в реальном времени интеллектуальное поражение людей от ИИ.

Когда бестелесные алгоритмы…

Лишь 15 россиян способны программировать лучше ИИ, в Китае таких еще 59, а в США осталось лишь 7.

Потрясающее зрелище – наблюдать в реальном времени интеллектуальное поражение людей от ИИ.

Когда бестелесные алгоритмы…

Недоказуемых выборных махинаций больше не будет.

Махинации, увы, останутся, но спрятать их станет уже невозможно.

Открыта универсальная закономерность в электоральных результатах. И она оказалась столь наглядна, что достаточно лишь взглянуть на распределение результатов выборов и явки, чтобы понять масштаб махинаций (см. рисунок).

Открытая универсальная закономерность подтверждена совпадением результатов экспериментального моделирования с фактическими данными о выборах в 32 странах за последние 70 лет. Найденная универсальная закономерность может служить тонким статистическим инструментом для обнаружения избирательных нарушений. И это уже не гипотеза из препринта, а вывод прошедшей строгое рецензирование в солидном APS Physical Review Journal работы группы физиков из индийского IISER Pune.

Предыстория открытия такова.

• В октябре 2022 я рассказывал про «китайскую комнату наоборот» - супероткрытие способа создания алгоритмических копий любых социальных групп.

• А в ноябре прошлого года я писал о новых прорывных работах, на наших глазах превращающих психоисторию из вымышленной Азимовым фантастической науки (позволяющей математическими методами исследовать происходящие в обществе процессы и благодаря этому предсказывать будущее с высокой степенью точности) в реальные научно-исследовательские и практические проекты.

Новое открытие продолжает два вышеназванных. И сделано оно в рамках проекта «Информация о выборах», проводимого лабораторией проф. Сантханама, ведущей исследования в области хаоса и нелинейной динамики, квантового хаоса и вычислений, машинного обучения, статистической физики, сложных сетей, экстремальных событий и сложных систем.

Авторы задались вопросом - можно ли предсказать отрыв победителя (т.е. маржу (margin), представляющую собой разницу в числе голосов между победителем выборов и кандидатом, занявшим второе место.

И получили ответ – да, можно.

Разработанная модель предсказывает, что статистика победного отрыва в выборах определяется исключительно распределением явки избирателей.

Т.е. достаточно знать распределение явки избирателей, и подтасовать результаты выборов, не будучи пойманным на махинациях, будет невозможно.

Как ответят махинаторы на этот научный прорыв, - к сожалению, очевидно.

#Социология #Выборы

_______

Источник | #theworldisnoteasy

Махинации, увы, останутся, но спрятать их станет уже невозможно.

Открыта универсальная закономерность в электоральных результатах. И она оказалась столь наглядна, что достаточно лишь взглянуть на распределение результатов выборов и явки, чтобы понять масштаб махинаций (см. рисунок).

Открытая универсальная закономерность подтверждена совпадением результатов экспериментального моделирования с фактическими данными о выборах в 32 странах за последние 70 лет. Найденная универсальная закономерность может служить тонким статистическим инструментом для обнаружения избирательных нарушений. И это уже не гипотеза из препринта, а вывод прошедшей строгое рецензирование в солидном APS Physical Review Journal работы группы физиков из индийского IISER Pune.

Предыстория открытия такова.

• В октябре 2022 я рассказывал про «китайскую комнату наоборот» - супероткрытие способа создания алгоритмических копий любых социальных групп.

• А в ноябре прошлого года я писал о новых прорывных работах, на наших глазах превращающих психоисторию из вымышленной Азимовым фантастической науки (позволяющей математическими методами исследовать происходящие в обществе процессы и благодаря этому предсказывать будущее с высокой степенью точности) в реальные научно-исследовательские и практические проекты.

Новое открытие продолжает два вышеназванных. И сделано оно в рамках проекта «Информация о выборах», проводимого лабораторией проф. Сантханама, ведущей исследования в области хаоса и нелинейной динамики, квантового хаоса и вычислений, машинного обучения, статистической физики, сложных сетей, экстремальных событий и сложных систем.

Авторы задались вопросом - можно ли предсказать отрыв победителя (т.е. маржу (margin), представляющую собой разницу в числе голосов между победителем выборов и кандидатом, занявшим второе место.

И получили ответ – да, можно.

Разработанная модель предсказывает, что статистика победного отрыва в выборах определяется исключительно распределением явки избирателей.

Т.е. достаточно знать распределение явки избирателей, и подтасовать результаты выборов, не будучи пойманным на махинациях, будет невозможно.

Как ответят махинаторы на этот научный прорыв, - к сожалению, очевидно.

Номером 1 в приоритетах махинаций уже на следующих выборах во многих странах станут данные о явке избирателей.

#Социология #Выборы

_______

Источник | #theworldisnoteasy

Telegram

Малоизвестное интересное

Недоказуемых выборных махинаций больше не будет.

Махинации, увы, останутся, но спрятать их станет уже невозможно.

Открыта универсальная закономерность в электоральных результатах. И она оказалась столь наглядна, что достаточно лишь взглянуть на распределение…

Махинации, увы, останутся, но спрятать их станет уже невозможно.

Открыта универсальная закономерность в электоральных результатах. И она оказалась столь наглядна, что достаточно лишь взглянуть на распределение…

Забудьте о законах робототехники.

Наивно думать, будто сильно умный ИИ всегда будет играть по правилам. Более того, - если ИИ чувствует себя интеллектуально слабее, он начинает жульничать по-черному.

Примерно в 6–7 лет дети начинают осознанно жульничать (а неосознанно, вдвое раньше), целенаправленно нарушая правила игры для достижения победы.

У взрослых же это просто норма. При столкновении с более сильным противником способность творчески нарушить правила, чтобы выиграть, - крайне ценное умение на войне, в бизнесе, на экзаменах, да и, вообще, в любой соревновательной деятельности.

Не зря же во всех языках есть пословицы типа:

«Правила созданы для того, чтобы их нарушать», «Мудрец не нуждается в правилах», «Правила для глупых, умные найдут выход» и т.д.:

• Rules are made to be broken – англ

• Wise men don't need rules, and fools won't follow them – нем

• Las reglas están hechas para romperse – испан

• Les règles sont faites pour être enfreintes – фран

• Le regole sono fatte per essere infrante – итал

• Reëls is daar om gebreek te word – африкан

• अक्लमंद इंसान नियमों से ऊपर होता है – хинди

• 聪明人不拘小节 – кит

• 規則は破るためにある – япон

• الحكيم لا يحتاج إلى قواعد – араб

• и др.

Но как же нужно быть наивным, чтобы рассчитывать, будто языковые модели, превосходящие по многим интеллектуальным способностям 95% людей, будут всегда следовать установленным для них людьми правилам!

И неважно о каких правилах будет идти речь: от законов робототехники до библейского не убий.

Новое исследование стартапа из Беркли Palisade Research (в команде которого половина наших релокантов) показывает, как модели, вместо честной шахматной игры, нарушают правила (хакают окружение), чтобы добиться победы над противником, который оказался сильнее их.

Например, ИИ-системы (ИИ-агенты) на основе моделей o1 preview и DeepSeek R1, играя против более сильной чем они шахматной программой Stockfish, используют арсенал методов, превосходящих даже Остапа Бендера в партии с одноглазым любителем из Васюков:

• Перезапись шахматной доски в контрольном файле (вспомните крик одноглазого любителя из Васюков – «Только что на этом месте стояла моя ладья. А теперь её уже нет!»):

Модель напрямую изменяет файл, в котором хранится текущее состояние доски, записывая в него позицию, которая гарантированно ведёт к победе. Так, изменив позицию на выигрышное для себя расположение фигур, агент вынуждает движок сдавать партию (ведб фраза «у меня все ходы записаны» здесь уже не поможет).

• Замена шахматного движка (это как подпоить противника):

ИИ-агент вмешивается в процесс игры, изменяя скрипт или файлы, отвечающие за запуск Stockfish. Такой ход позволяет «подменить» настоящий движок на модифицированную версию или отключить его, что даёт ИИ-агенту преимущество.

• Ассистированная игра через запуск дополнительного экземпляра Stockfish (это как играть с наушником в ухе, через который вам подсказывает гроссмейстер):

Модель запускает ещё один экземпляр шахматного движка, который генерирует ходы, что может сбивать с толку основной движок или создавать ситуацию, где ИИ-агент получает дополнительную помощь в выборе ходов. Это позволяет обойти обычную логику игры.

Т.е. при столкновении с непобедимым соперником (сильным шахматным движком) ИИ-агенты склонны искать обходные пути, изменяя условия задачи вместо честного соперничества.

А как же иначе?

Ведь если на всех языках людей «Правила для глупых, умные найдут выход», - почему у полиглота ИИ будет иначе?

P.S. Исследователи пишут, что разработчики знают об этом и ставят ограды от жульничества в самых последних моделях. Но ведь модели знают и то, что:

• "Умный в гору не пойдет, умный гору обойдет."

• "Законы пишутся для дураков, умные найдут лазейку."

#Superalignment

_______

Источник | #theworldisnoteasy

Наивно думать, будто сильно умный ИИ всегда будет играть по правилам. Более того, - если ИИ чувствует себя интеллектуально слабее, он начинает жульничать по-черному.

Примерно в 6–7 лет дети начинают осознанно жульничать (а неосознанно, вдвое раньше), целенаправленно нарушая правила игры для достижения победы.

У взрослых же это просто норма. При столкновении с более сильным противником способность творчески нарушить правила, чтобы выиграть, - крайне ценное умение на войне, в бизнесе, на экзаменах, да и, вообще, в любой соревновательной деятельности.

Не зря же во всех языках есть пословицы типа:

«Правила созданы для того, чтобы их нарушать», «Мудрец не нуждается в правилах», «Правила для глупых, умные найдут выход» и т.д.:

• Rules are made to be broken – англ

• Wise men don't need rules, and fools won't follow them – нем

• Las reglas están hechas para romperse – испан

• Les règles sont faites pour être enfreintes – фран

• Le regole sono fatte per essere infrante – итал

• Reëls is daar om gebreek te word – африкан

• अक्लमंद इंसान नियमों से ऊपर होता है – хинди

• 聪明人不拘小节 – кит

• 規則は破るためにある – япон

• الحكيم لا يحتاج إلى قواعد – араб

• и др.

Но как же нужно быть наивным, чтобы рассчитывать, будто языковые модели, превосходящие по многим интеллектуальным способностям 95% людей, будут всегда следовать установленным для них людьми правилам!

И неважно о каких правилах будет идти речь: от законов робототехники до библейского не убий.

Новое исследование стартапа из Беркли Palisade Research (в команде которого половина наших релокантов) показывает, как модели, вместо честной шахматной игры, нарушают правила (хакают окружение), чтобы добиться победы над противником, который оказался сильнее их.

Например, ИИ-системы (ИИ-агенты) на основе моделей o1 preview и DeepSeek R1, играя против более сильной чем они шахматной программой Stockfish, используют арсенал методов, превосходящих даже Остапа Бендера в партии с одноглазым любителем из Васюков:

• Перезапись шахматной доски в контрольном файле (вспомните крик одноглазого любителя из Васюков – «Только что на этом месте стояла моя ладья. А теперь её уже нет!»):

Модель напрямую изменяет файл, в котором хранится текущее состояние доски, записывая в него позицию, которая гарантированно ведёт к победе. Так, изменив позицию на выигрышное для себя расположение фигур, агент вынуждает движок сдавать партию (ведб фраза «у меня все ходы записаны» здесь уже не поможет).

• Замена шахматного движка (это как подпоить противника):

ИИ-агент вмешивается в процесс игры, изменяя скрипт или файлы, отвечающие за запуск Stockfish. Такой ход позволяет «подменить» настоящий движок на модифицированную версию или отключить его, что даёт ИИ-агенту преимущество.

• Ассистированная игра через запуск дополнительного экземпляра Stockfish (это как играть с наушником в ухе, через который вам подсказывает гроссмейстер):

Модель запускает ещё один экземпляр шахматного движка, который генерирует ходы, что может сбивать с толку основной движок или создавать ситуацию, где ИИ-агент получает дополнительную помощь в выборе ходов. Это позволяет обойти обычную логику игры.

Т.е. при столкновении с непобедимым соперником (сильным шахматным движком) ИИ-агенты склонны искать обходные пути, изменяя условия задачи вместо честного соперничества.

А как же иначе?

Ведь если на всех языках людей «Правила для глупых, умные найдут выход», - почему у полиглота ИИ будет иначе?

P.S. Исследователи пишут, что разработчики знают об этом и ставят ограды от жульничества в самых последних моделях. Но ведь модели знают и то, что:

• "Умный в гору не пойдет, умный гору обойдет."

• "Законы пишутся для дураков, умные найдут лазейку."

#Superalignment

_______

Источник | #theworldisnoteasy

Telegram

Малоизвестное интересное

Забудьте о законах робототехники.

Наивно думать, будто сильно умный ИИ всегда будет играть по правилам. Более того, - если ИИ чувствует себя интеллектуально слабее, он начинает жульничать по-черному.

Примерно в 6–7 лет дети начинают осознанно жульничать (а…

Наивно думать, будто сильно умный ИИ всегда будет играть по правилам. Более того, - если ИИ чувствует себя интеллектуально слабее, он начинает жульничать по-черному.

Примерно в 6–7 лет дети начинают осознанно жульничать (а…